Különösen aggasztó az a jelenség, amely az elmúlt hónapokban robbanásszerűen terjedt el az Instagramon és a TikTokon. Tömegesen jelennek meg az olyan profilok, amelyek első bejegyzései megrázó életutakat mutatnak be: nehéz gyerekkort, családi tragédiákat, szegénységgel vagy igazságtalansággal vívott küzdelmet. A közönség pedig ezek láttán gyorsan érzelmileg kötődni kezd, együttérez az állítólagos megosztóval, támogatja őt és megosztja az általa közzétett tartalmat. Ezután azonban szinte észrevétlen fordulat következik: provokatív videók jelennek meg előttünk, finom utalásokkal arra, hogy regisztráljunk az és fizessünk elő a havi díjas „exkluzív tartalomra”, amelyek az esetek döntő többségében teljes egészében mesterséges intelligencia által generáltak.

A Bizlife.rs írása szerint a legnagyobb gondot az jelenti, hogy sok felhasználó egyáltalán nem érzékeli a megtévesztést. Nemcsak hisznek ezekben a történetekben, hanem védelmükbe is veszik a készítőit, vitákba bocsátkoznak, és érzelmileg kötődnek olyan digitális személyekhez, akik valójában soha nem is léteztek. Az ilyesmi persze súlyos következményekkel járhat és egyre nehezebb megkülönböztetni a valóságot a mesterséges konstrukcióktól, miközben lassan meginog a képekbe és videókba vetett bizalmunk is.

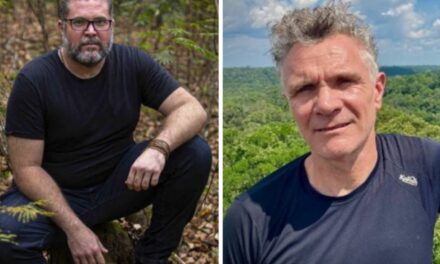

A probléma intézményi szinten is megjelent. Jó példa erre az a belgrádi eset, amikor a Belügyminisztérium egy gyanúsítottról MI-vel „feljavított” képet tett közzé, amely alig hasonlított a valódi személyre. Azzal pedig, félrevezették a közvéleményt, hogy nem jelezték egyértelműen a kép mesterséges módosítását, és tovább rontotta a hiteles tájékoztatás esélyét.

Felülről: a A MUP által eredetileg közzétett MI segítségével készített felvétel a gyanúsítottról . Alulról: Az utólag közzétett, valódi felvétel a gyanúsítottról .

Forrás: N1 (MUP Srbije)

Ilyen helyzetekben az átláthatóság nem választható lehetőség, hanem alapkövetelmény, aminek hiányában maguk az intézmények járulnak hozzá a manipuláció normalizálásához, ami különösen veszélyes a közbiztonság és az állampolgári bizalom szempontjából.

Bár a technológia gyorsan fejlődik, még mindig vannak figyelmeztető jelek, amelyek segíthetnek az MI-tartalmak felismerésében. Ilyen a természetellenes mozgás, a furcsa pislogás, a nem összeillő arckifejezések, és a „műanyag” bőrhatás. De ezek közé tartoznak a túl tökéletesen megszerkesztett, érzelmekre ható történetek; újonnan létrehozott vagy hirtelen irányt váltó profilok; monoton, gépies hang vagy apró kiejtési hibák. Ezek a jelek mindenképpen arra figyelmeztetnek, hogy mielőtt megosztanánk valamit, álljunk megy egy pillanatra és vizsgáljuk meg alaposabban az adott fotót, videót vagy pedig szöveget.

Ugyanakkor a mesterséges intelligencia önmagában nem jelent különösebb problémát.

Az igazi veszély akkor kezdődik, amikor a világos szabályok, felelősség és etikai korlátok nélkül használják érzelmek, döntések és vélemények formálására. Amennyiben pedig nem tanulunk meg kritikusak, óvatosak és tájékozottak lenni, könnyen olyan világban ébredhetünk, ahol az igazság már nem a tényeken, hanem az algoritmus minőségén múlik. Ez pedig olyan ár, amelyet egyetlen társadalom sem engedhet meg magának.